「AIで作った画像を販売したら、ある日突然、著作権侵害の通知が届いた──」これは決して他人事ではありません。2025年だけで、AI関連の著作権訴訟の和解額は世界累計で4,000億円を超えました。AI副業で月5万円、10万円と稼ぐ人が急増する一方、著作権トラブルで数百万円の損害賠償を請求されるケースも現実に起きています。「知らなかった」は言い訳になりません。本記事では、AI副業を安全に行うために不可欠な著作権の基礎知識から、主要AIツール別の商用利用ルール、2025年の衝撃的な判例、そして実践的なチェックリストまで、法律の専門知識がなくても理解できるよう徹底解説します。この記事を読めば、次の3つが手に入ります。

- AI副業で犯しやすい著作権侵害パターン5つとその回避策がわかる

- 主要AIツール(ChatGPT/Midjourney/Stable Diffusion等)の商用利用OKラインが明確になる

- 今日から使える「安全なAI副業」のための7つの実践チェックリストが手に入る

この記事の目次

AI副業ブームの裏に潜む「著作権」という地雷

生成AIの急速な普及により、副業の世界は大きく変わりました。ChatGPTで記事を書き、Midjourneyでイラストを作り、Stable Diffusionでストック画像を量産する──こうした「AI副業」は、初期費用が低く、特別なスキルがなくても始められるとあって、2024年から2025年にかけて爆発的に広がっています。しかし、この「誰でも簡単に始められる」という手軽さの裏側に、大きな落とし穴が潜んでいます。それが「著作権」の問題です。

なぜ今、AI副業の法律知識が重要なのか

総務省の「情報通信白書(令和6年版)」によると、生成AIを業務や副業に活用している日本人の割合は約35%に達しています。わずか2年前(2023年)の12%と比較すると、およそ3倍の伸びです。市場規模も拡大を続けており、Grand View Researchの調査では、生成AI市場は2025年に約670億ドル(約10兆円)に達すると予測されています。

こうした急速な普及に対し、法整備は追いついていないのが現状です。著作権法は、もともとAIによるコンテンツ生成を想定して作られたものではありません。そのため、「AIが生成したものに著作権はあるのか」「AIの学習に使われた著作物の権利はどうなるのか」「AI生成物を販売して良いのか」といった根本的な問いに対して、法的なグレーゾーンが数多く存在しています。

このグレーゾーンこそが、AI副業の最大のリスクです。「法律に明確に禁止されていないから大丈夫」と思って活動していたら、ある日突然、損害賠償請求の内容証明が届く──こうした事態は、すでに世界各地で起きています。

著作権トラブルで実際に起きていること

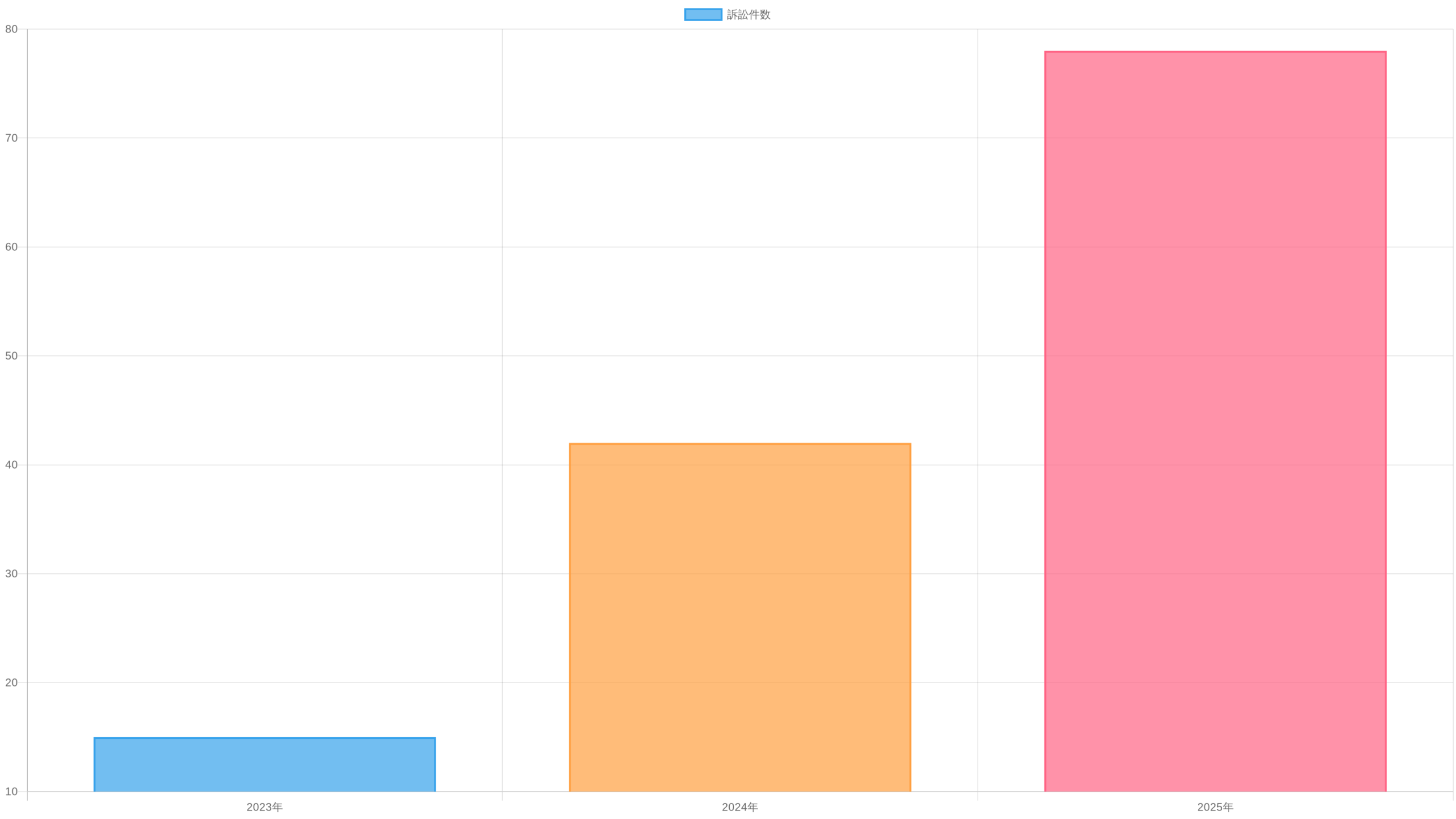

2025年の時点で、AI関連の著作権訴訟は世界で100件以上が同時進行しています。その中でも象徴的な事例をいくつか紹介しましょう。

まず、AI著作権訴訟史上最大の和解となったBartz v. Anthropic事件。著作権を持つ作家たちがAI企業Anthropicを集団提訴し、15億ドル(約2,250億円)という史上最高額で和解が成立しました。このニュースは世界中を震撼させ、「AI企業も無制限に著作物を学習に使えるわけではない」ということを明確に示しました。

日本国内でも動きが活発化しています。2025年には読売新聞がAI検索サービス「Perplexity AI」に対して約22億円の損害賠償を請求する訴訟を起こしました(読売新聞オンライン)。新聞記事をAIが無断で要約・転載しているという主張です。さらに、朝日新聞もOpenAIに対して同様の訴訟を提起しています。

これらは大企業同士の訴訟ですが、個人のAI副業にも波及する問題です。なぜなら、同じ法律(著作権法)が適用されるからです。企業であれ個人であれ、著作権を侵害すれば、刑事罰として10年以下の懲役もしくは1,000万円以下の罰金、民事では損害賠償請求の対象となります。

注意:著作権侵害は「知らなかった」では免責されません。日本の著作権法は「過失責任」も認めており、注意義務を怠った場合は故意がなくても責任を問われます。AI副業を行う以上、最低限の法律知識は必須です。

そもそも著作権とは?AI時代の基本ルール

AI副業の法的リスクを理解するためには、まず「著作権」そのものの基礎を知る必要があります。難しい法律用語が並ぶイメージがあるかもしれませんが、ここでは30秒で理解できるように、本当に大事なポイントだけを絞って解説します。

著作権法の基礎知識(30秒でわかる)

著作権とは、「思想または感情を創作的に表現したもの」に自動的に発生する権利です(著作権法第2条第1項第1号)。ここでのキーワードは「創作的」と「表現」の2つです。

| 要素 | 意味 | 具体例 |

|---|---|---|

| 思想または感情 | 人間の精神活動の産物 | 小説のストーリー、絵画のモチーフ |

| 創作的 | オリジナリティがあること | 単なるデータの羅列はNG、独自の表現はOK |

| 表現したもの | 外部に表現されていること | アイデアそのものは保護対象外、具体的な文章・絵は保護対象 |

重要なのは、著作権は登録や申請なしで自動的に発生するという点です。ブログ記事を書いた瞬間、イラストを描いた瞬間に著作権が生まれます。つまり、あなたがAIで作ったコンテンツが既存の著作物に似ていた場合、相手が著作権登録をしていなくても権利侵害になり得るのです。

また、著作権には以下のような「権利の束」が含まれています。

- 複製権:著作物をコピーする権利(AIが学習時にデータをコピーする行為に関係)

- 翻案権:著作物を翻訳・編曲・変形する権利(「〇〇風」の生成に関係)

- 公衆送信権:著作物をインターネット上で公開する権利(ブログ・SNSへの投稿に関係)

- 同一性保持権:著作物を著者の意に反して改変されない権利(AIによる加工に関係)

- 氏名表示権:著作者名を表示する・しないを決める権利

AI生成物の著作権はどうなる?「3つのフェーズ」で理解する

AI副業における著作権の問題は、大きく「3つのフェーズ」に分けて理解すると整理しやすくなります。

フェーズ1:AIの学習段階(開発・学習フェーズ)

AIモデルが大量のデータ(テキスト・画像・音楽など)を学習する段階です。日本では著作権法第30条の4により、「著作物の表現を享受しない利用」であればAI学習での著作物利用は原則として許可されています。これは世界的に見ても非常に寛容な規定で、日本がAI開発において有利とされる大きな要因です。

ただし、但し書きとして「著作権者の利益を不当に害することとなる場合は、この限りでない」と規定されており、無制限に許可されるわけではありません。例えば、特定のクリエイターの作品だけを大量に学習し、そのクリエイターの市場を直接奪うような利用は、但し書きに該当する可能性があります。

フェーズ2:AI生成段階(プロンプト入力〜出力)

ユーザーがAIにプロンプトを入力し、テキストや画像が生成される段階です。ここで問題になるのは、生成物が既存の著作物に類似していた場合です。AIがたまたま学習データに含まれていた著作物と酷似したものを出力した場合、それを使用・販売すると著作権侵害になり得ます。

重要なポイントは、「AIが勝手に作った」は免責の理由にならないということです。文化庁の見解では、AI生成物であっても、既存の著作物に依拠し(学習データに含まれ)、類似している場合は、著作権侵害が成立すると解釈されています。

フェーズ3:AI生成物の利用段階(公開・販売・配布)

AI生成物を実際にブログに掲載したり、素材として販売したり、SNSに投稿したりする段階です。ここでは「AI生成物に著作権は発生するのか?」という問いが重要になります。

2025年3月のThaler v. Perlmutter判決(米国控訴裁)では、「AIは著作者(author)にはなれない」という判断が確認されました。つまり、AIだけで作ったものには著作権が発生しません。しかし、人間が創作的に関与した場合には著作権が認められる可能性があります。具体的には、プロンプトの工夫、生成後の加工・編集、複数の出力からの選択と組み合わせなど、人間の「創作的寄与」がどの程度あるかがポイントになります。

この3つのフェーズを理解しておけば、「どの段階で何に気をつければいいのか」が明確になります。AI副業においては、特にフェーズ2(生成時の類似性チェック)とフェーズ3(利用時のルール遵守)が重要です。

【要注意】AI副業で犯しやすい著作権侵害パターン5選

AI副業初心者がうっかり犯してしまう著作権侵害のパターンは、実はかなり限られています。ここでは、特に多い5つのパターンを具体例とともに解説します。自分が同じことをしていないか、チェックしながら読んでみてください。

パターン1:「〇〇風」プロンプトの危険性

AI画像生成で最も多い著作権トラブルが、「〇〇風」というプロンプトの使用です。例えば、「ジブリ風の風景画を生成して」「ディズニー風のキャラクターを作って」「鳥山明風のイラスト」といったプロンプトです。

これらのプロンプトで生成された画像が、元の著作物と「類似」していると判断された場合、翻案権侵害に該当する可能性があります。「風」と付けていても、結果として生成された画像が元の作品の本質的な表現を再現していれば、法的には侵害となり得ます。

特に注意が必要なのは、キャラクターの著作権です。キャラクターのデザインは著作物として強く保護されており、AIが「偶然」似たものを生成した場合でも、そのキャラクターの著作権者から訴えられるリスクがあります。2024年には、AIで生成した「某有名キャラクターに酷似した画像」をTシャツにプリントして販売していた個人が、権利者から差し止め請求を受けた事例も報告されています。

回避策:特定の作家名、作品名、キャラクター名をプロンプトに含めないこと。代わりに、「水彩画風」「ミニマルなイラスト」「暖色系の柔らかいタッチ」など、一般的な画風の表現を使いましょう。画風(スタイル)自体には著作権は発生しませんが、特定の作家に結びつく表現は避けるのが安全です。

パターン2:AI生成物の無加工商用利用

AIが生成したテキストや画像を、一切加工せずにそのまま商用利用するのも危険なパターンです。問題は主に2つあります。

第一に、既存著作物との類似性リスク。AIは学習データに基づいて出力を生成するため、特定の条件下では学習データに含まれる著作物と酷似した出力を生成することがあります。特にテキスト生成AIでは、学習データ中の文章がほぼそのまま出力されるケースが報告されています(Carlini et al., 2023)。

第二に、著作権の帰属問題。前述の通り、AIだけで作ったものには著作権が発生しない可能性があります。つまり、あなたが「自分のオリジナル作品だ」と主張しても、法的には保護されない可能性があるのです。第三者が同じ画像を自由にコピーして使っても、あなたはそれを止められないかもしれません。

回避策:AI生成物は必ず人間が加工・編集してから使用しましょう。テキストなら独自の視点や体験を追加し、画像なら構図の変更や色調の調整、要素の追加・削除を行います。こうした「人間の創作的寄与」を加えることで、著作権が認められやすくなり、また既存著作物との類似性も低下します。

パターン3:有名人の肖像をAIで生成

AIを使って有名人の顔を生成し、それを使ったコンテンツを作る──これは著作権だけでなく、肖像権やパブリシティ権の侵害にもなる、極めて危険な行為です。

2025年10月には、AIで生成した実在の有名人の偽画像を販売していた人物が逮捕される事件が発生しました。AI生成だからといって「フェイクだとわかるから問題ない」という言い訳は通用しません。実在の人物を想起させる画像を、その人の許可なく商用利用すること自体が法的問題となります。

米国では2025年5月に「TAKE IT DOWN Act」が成立し、AI生成のディープフェイクコンテンツの配布を連邦犯罪としました(米国議会ウェブサイト)。日本でも同様の規制強化が議論されており、AI生成の偽画像に対する法的リスクは今後さらに高まることが予想されます。

回避策:実在の人物に似せた画像は生成しないこと。AIイラストでも、特定の有名人を想起させるプロンプト(名前、特徴的な外見の記述)は避けましょう。ストックフォトを使用する場合も、モデルリリース(肖像権の使用許諾)が付いているものを選んでください。

パターン4:他者の記事をAIで翻訳・要約して公開

海外の記事やニュースをAIで翻訳し、自分のブログに掲載する。あるいは、他者の記事をAIで要約して「まとめ記事」を作成する。これらの行為も著作権侵害のリスクが高いパターンです。

翻訳は著作権法上の「二次的著作物」の作成にあたり、原著作者の翻訳権(27条)の範囲です。AIが翻訳を行っても、それを公開するのは人間(あなた)であり、権利侵害の責任はあなたに帰属します。読売新聞がPerplexity AIに対して起こした訴訟も、まさにこのパターンに該当します。AIが記事を「要約」して表示していること自体が著作権侵害だという主張です。

特に注意が必要なのは、「AIが要約したから元の表現とは違う」という主張が通らない可能性がある点です。要約であっても、元の記事の核心的な内容や独自の分析をそのまま利用していれば、翻案権侵害となり得ます。

回避策:他者のコンテンツをAIで翻訳・要約する場合は、必ず原著作者の許可を得るか、引用のルール(出典明記、主従関係の維持、必要最小限の範囲)を厳守しましょう。単なるコピーではなく、自分独自の分析や見解を中心に据えた上で、引用として最小限に言及するのが安全です。

パターン5:LoRAによる特定クリエイターの画風模倣

LoRA(Low-Rank Adaptation)は、既存のAIモデルを少量のデータで微調整する技術です。特定のクリエイターの作品を数十枚学習させるだけで、そのクリエイターの画風をほぼ完璧に再現できてしまいます。この技術を使って「有名イラストレーターの画風で画像を量産し、販売する」という行為は、法的にも倫理的にも大きな問題をはらんでいます。

日本の著作権法では「画風」自体は著作権の保護対象外とされています。しかし、LoRAで生成された画像が元のクリエイターの具体的な作品の表現を再現している場合、著作権侵害となります。また、画風の模倣自体が著作権侵害にならなくても、不正競争防止法の「周知表示混同惹起行為」(2条1項1号)に該当する可能性があります。特定のクリエイターの画風が市場で広く知られている場合、その画風を模倣した商品を販売することは、消費者に誤認を生じさせる行為とみなされる可能性があるのです。

さらに、イラストレーターコミュニティからのレピュテーションリスクも無視できません。2024年には、特定のイラストレーターの画風を模倣したLoRAモデルの配布者が、コミュニティから大きな非難を浴び、SNSアカウントの特定・晒しが行われる事件も発生しました。法的リスク以前に、社会的信用を失うリスクが極めて高い行為です。

回避策:特定のクリエイターの作品でLoRAを学習させることは避けましょう。公式に許可されたデータセットや、パブリックドメインの作品を使用してください。また、生成した画像が特定のクリエイターの作品と混同される可能性がないかを慎重に確認しましょう。

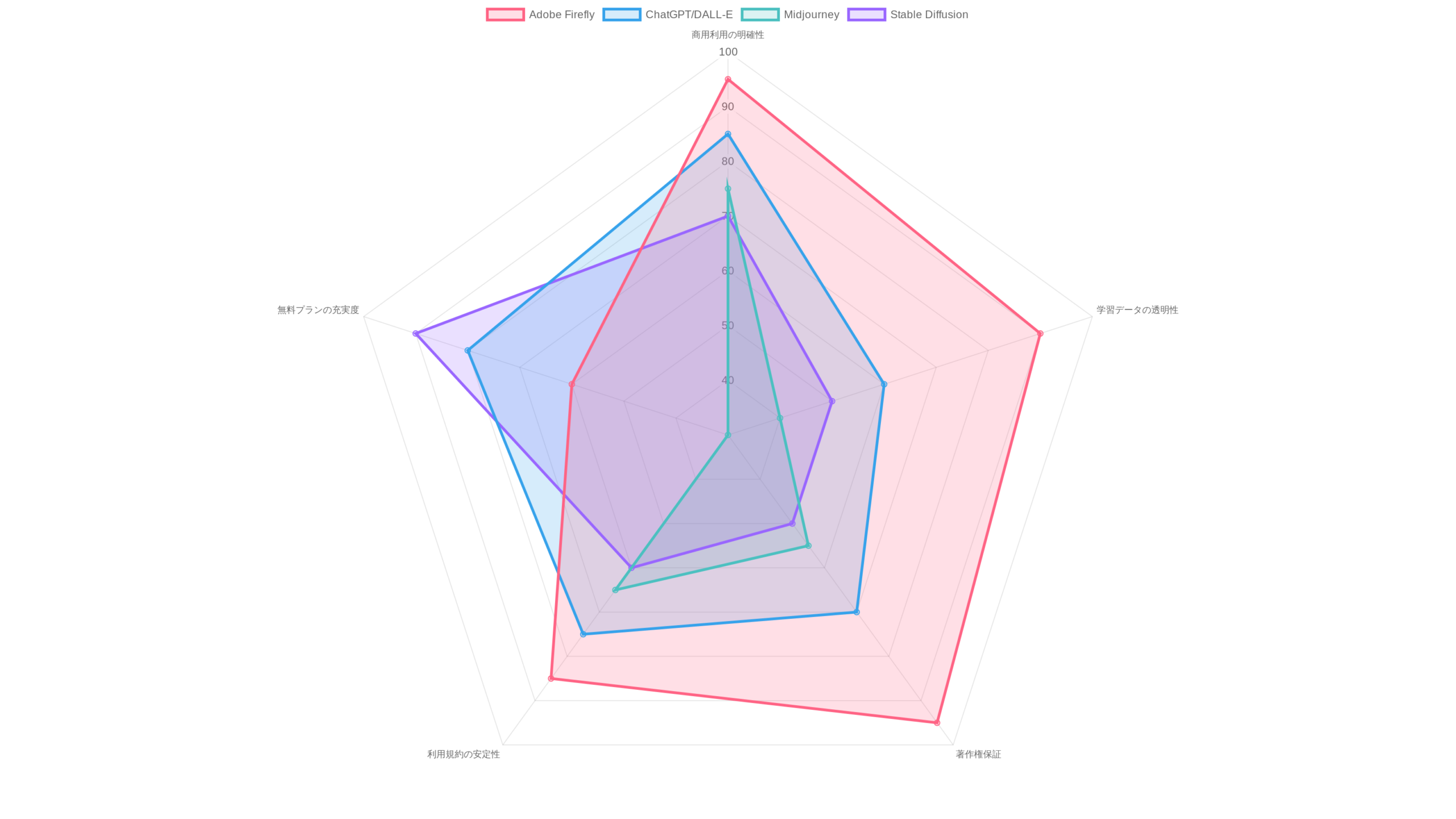

主要AIツール別|商用利用OKラインを徹底比較

AI副業を安全に行うためには、各AIツールの利用規約を正確に理解しておく必要があります。ここでは、主要な6つのAIツールの商用利用ルールを徹底比較します。利用規約は頻繁に更新されるため、必ず最新の規約を確認してください(以下は2025年11月時点の情報です)。

ChatGPT/DALL-E(OpenAI)の利用規約

OpenAIの利用規約は、AI副業にとって比較的使いやすい内容になっています。主なポイントは以下の通りです。

| 項目 | ルール | 備考 |

|---|---|---|

| 生成物の著作権帰属 | ユーザーに帰属 | OpenAIは権利を主張しない |

| 商用利用 | 可能 | 無料プラン・有料プランともにOK |

| 再販・転売 | 可能 | 生成物を商品として販売可 |

| AI生成物の開示義務 | 推奨されるが義務ではない | ただし法域によっては義務化の動きあり |

| コンテンツポリシー | 暴力・違法コンテンツ等は禁止 | DALL-Eにはフィルタリングあり |

ChatGPT/DALL-Eの最大のメリットは、無料プランでも商用利用が可能という点です。ただし注意点が2つあります。第一に、DALL-Eで生成した画像が既存の著作物に類似している場合、OpenAIの規約で許可されていても著作権侵害の責任はユーザーが負います。OpenAIは「生成物が第三者の権利を侵害していないことを保証しない」と明記しています。

第二に、ChatGPT APIを使用する場合と、Web版・アプリ版を使用する場合で規約が異なる点があります。API経由の場合、入出力データがモデルの学習に使用されないことが保証されますが、Web版の無料プランではデフォルトでデータが学習に使用される可能性があります(設定で変更可能)。機密性の高いビジネスコンテンツを作成する場合は、この設定を確認しておきましょう。

Midjourney・Stable Diffusionの注意点

画像生成AIとして人気の高いMidjourneyとStable Diffusionですが、それぞれ商用利用のルールが異なります。

Midjourney

Midjourneyの利用規約では、商用利用に関して以下のルールが定められています。

- 無料プラン:商用利用は不可。個人的な非商用利用のみ許可

- 有料プラン(Basic/Standard/Pro):商用利用可。ただし条件あり

- 年間収益100万ドル(約1.5億円)超の企業:Pro Plan以上が必須

- ステルスモード:Pro Plan以上で利用可。生成画像を他のMidjourneyユーザーから非公開にできる

Midjourneyの重要な注意点は、無料プランでは商用利用が一切できないという点です。無料トライアルで生成した画像をそのままストック素材として販売したり、商用ブログに掲載したりすると規約違反となります。必ず有料プランに加入してから商用利用してください。

Stable Diffusion

Stability AIのライセンスは、バージョンやモデルによってルールが異なるため注意が必要です。

- Stable Diffusion XL(SDXL):オープンソースライセンス。商用利用可。年商100万ドル未満の制限あり(Stability AIのCreative ML OpenRAIL-Mライセンス)

- Stable Diffusion 3(SD3):Stability AI Community Licenseに基づく。年間売上100万ドル超の企業はエンタープライズライセンスが必要

- ローカル実行:モデルをローカルにダウンロードして使用する場合も、ライセンス条件は適用される

Stable Diffusionの特徴は、オープンソースであるためカスタマイズの自由度が高いことです。しかし、その分だけ責任もすべてユーザーに帰属します。学習データの著作権問題(Getty Images訴訟に代表される)は未解決であり、Stable Diffusionで生成した画像が訴訟対象になるリスクは常に存在します。

Adobe Firefly・Canva AIの安全性

著作権リスクを最小化したい場合に注目すべきなのが、Adobe FireflyとCanva AIです。

Adobe Firefly

Adobe Fireflyは、AI画像生成ツールの中で最も安全性が高いと評価されています。その理由は以下の通りです。

Adobe Fireflyの安全性ポイント

- 学習データが100%ライセンス済み:Adobe Stock、パブリックドメイン、Adobeが権利を持つコンテンツのみで学習

- 商用利用の「安全保証」:万が一著作権問題が発生した場合、Adobeが法的費用を負担する「IP補償(Indemnification)」を提供

- Content Credentials:生成画像にAI生成であることを示すメタデータを自動付与

- 有害コンテンツフィルタ:実在人物の顔生成を制限する機能搭載

特に「IP補償」は大きなメリットです。他のAIツールでは「生成物の著作権問題はユーザーの責任」としているのに対し、Adobeは企業として責任を共有する姿勢を示しています。ただし、IP補償はAdobe Creative Cloudの有料プランに加入していることが条件です。

Canva AI

CanvaのAI機能(Magic Design、Text to Image等)も、商用利用に適した設計になっています。

- 有料プラン(Canva Pro/Teams):AI生成画像の商用利用が可能

- 無料プラン:個人利用の範囲で使用可(商用利用は制限あり)

- 商標登録は不可:AI生成デザインをそのまま商標登録することは規約で禁止

- IP補償あり:Canvaの有料プランユーザー向けに、限定的なIP補償を提供

以下の表で、主要AIツールの商用利用ルールを一覧で比較できます。

| ツール名 | 商用利用 | 権利帰属 | IP補償 | 安全性評価 |

|---|---|---|---|---|

| ChatGPT/DALL-E | 可(全プラン) | ユーザー | なし | 中 |

| Midjourney | 可(有料のみ) | ユーザー(条件付き) | なし | 中 |

| Stable Diffusion | 可(条件付き) | ユーザー | なし | 低〜中 |

| Adobe Firefly | 可(有料推奨) | ユーザー | あり(有料プラン) | 高 |

| Canva AI | 可(有料推奨) | ユーザー | あり(有料プラン) | 高 |

| Google Gemini/Imagen | 可(規約に従う) | ユーザー | 限定的 | 中〜高 |

知らなかったでは済まない!著作権以外の法的リスク

AI副業で注意すべき法的リスクは、著作権だけではありません。「著作権は大丈夫だと思っていたのに、別の法律で訴えられた」というケースも少なくありません。ここでは、AI副業で見落としがちな3つの法的リスクを解説します。

肖像権・パブリシティ権の侵害

肖像権とは、自分の容貌や姿態をみだりに撮影されたり、公開されたりしない権利です。日本の法律では明文規定はありませんが、判例法上確立された権利として認められています。パブリシティ権は、有名人の氏名・肖像が持つ顧客吸引力を排他的に利用する権利です(ピンク・レディー事件最高裁判決 2012年)。

AI副業との関連では、以下のケースが問題になります。

- 実在の有名人に似せたAI画像の生成・販売:パブリシティ権侵害。商業目的での使用は高リスク

- AIディープフェイクの作成:肖像権侵害に加え、名誉毀損、わいせつ物頒布罪等にも該当し得る

- SNSから収集した一般人の写真をAI学習に使用:プライバシー侵害、個人情報保護法違反の可能性

- AI生成した「架空の人物」が実在人物に偶然似ていた場合:肖像権侵害のリスクあり

2025年10月に報道されたAI偽画像販売での逮捕事件は、まさにこの分野のリスクを象徴しています。AI生成であることは免責理由にはならず、むしろ「大量に生成・頒布できる」という点で、従来の肖像権侵害よりも重い罰則が科される傾向にあります。

また、米国で2025年5月に成立したTAKE IT DOWN Actは、AIで生成された非同意の親密な画像の配布を連邦犯罪としました。日本でも同様の法整備が進められており、2026年の通常国会で関連法案が提出される見通しです。

商標権侵害のリスク

商標権は、商品やサービスを識別するための標識(ブランド名、ロゴ、マーク等)に関する権利です。著作権とは異なり、特許庁への登録が必要です。AI副業では、以下のケースで商標権侵害のリスクが生じます。

| 行為 | リスクレベル | 具体例 |

|---|---|---|

| ブランドロゴに似たAI生成画像の商用利用 | 高 | Nikeのスウッシュに類似したロゴを使用 |

| 商標登録されたキャラクターの模倣 | 高 | ポケモン、ディズニーキャラクターの類似品 |

| 商標名を含むAI生成コンテンツの販売 | 中〜高 | 「iPhone風ケースデザイン」の販売 |

| ブランド名を含むプロンプトの使用 | 低〜中 | プロンプト自体は問題ないが、生成物に注意 |

特にAI画像生成では、プロンプトにブランド名を含めなくても、AIが学習データからブランドロゴやキャラクターに類似した画像を生成することがあります。生成された画像に既存の商標と混同される要素が含まれていないか、必ずチェックしてから使用しましょう。

商標権侵害の罰則は、10年以下の懲役もしくは1,000万円以下の罰金、またはその併科(商標法78条)と、著作権侵害と同等の重さです。

不正競争防止法への抵触

不正競争防止法は、事業者間の公正な競争を維持するための法律です。AI副業において特に注意すべき条項は以下の3つです。

1. 周知表示混同惹起行為(2条1項1号)

他人の商品・営業の表示として広く認識されているものと同一・類似の表示を使用し、混同を生じさせる行為です。例えば、有名クリエイターの画風を模倣した商品を、あたかもそのクリエイターの作品であるかのように販売する行為が該当します。

2. 著名表示冒用行為(2条1項2号)

他人の著名な商品・営業の表示を自己の表示として使用する行為です。著名ブランドのデザイン要素をAIで生成して使用するケースが該当し得ます。こちらは「混同」がなくても成立するため、「明らかに別ブランドだとわかる」場合でも違反となる可能性があります。

3. 商品形態模倣行為(2条1項3号)

他人の商品の形態を模倣した商品を譲渡等する行為です。他社が販売しているデザイン商品の形態をAIで模倣し、類似商品を販売する行為が該当します。商品の最初の販売から3年間保護されます。

不正競争防止法の特徴は、著作権法や商標法では保護されない「デッドゾーン」をカバーしている点です。「著作権にも商標にも引っかからないから大丈夫」と思っていても、不正競争防止法で摘発される可能性があることを覚えておきましょう。

世界のAI著作権訴訟|2025年の衝撃的判例まとめ

2025年は、AI著作権に関する重要な判例が世界中で相次いだ「判例ラッシュ」の年でした。これらの判例は、今後のAI副業のルールを大きく左右するものです。ここでは、特に影響の大きい4つの事例を詳しく解説します。

Anthropic 15億ドル和解事件

2025年に世界を震撼させたのが、Bartz v. Anthropic訴訟の和解です。著作権を持つ作家グループがAI企業Anthropicを集団提訴し、15億ドル(約2,250億円)というAI著作権訴訟史上最大の和解額で決着しました。

原告側の主張は、AnthropicのAI「Claude」の学習データに、原告らの著作物が無断で使用されたというものです。Anthropicは「著作権法上のフェアユースに該当する」と反論しましたが、最終的には和解を選択しました。

この訴訟がAI副業に与える影響は大きく、以下の3点が重要です。

- AI企業の学習データの合法性が疑問視される先例:AIツールの提供元が訴訟リスクを抱えているということは、そのツールを使って生成したコンテンツにも間接的にリスクが波及する可能性がある

- 権利者団体の訴訟戦略が確立:集団訴訟による高額和解の成功モデルが確立され、今後同様の訴訟が増える可能性が高い

- AI企業のライセンス交渉の加速:訴訟リスクを回避するため、AI企業がコンテンツ権利者とのライセンス契約を積極的に結ぶようになり、「安全な学習データで学習したAI」と「そうでないAI」の差別化が進む

Getty Images vs Stability AI訴訟

Getty Images vs Stability AI訴訟は、2023年に提起され、2025年も継続審理中の重要な訴訟です。ストックフォト大手のGetty Imagesが、Stability AIがGettyの画像を無断でStable Diffusionの学習データに使用したとして訴えています。

この訴訟で特に注目されたのは、Stable Diffusionが生成した画像にGetty Imagesのウォーターマーク(透かし)が表示されたという事実です。これは、AIモデルが学習データをほぼそのまま「記憶」し、再現している証拠として原告側に有利に働きました。

2025年の審理では、裁判所が以下の点について判断を示しました。

- AIの学習プロセスにおける著作物のコピーは「一時的な複製」に過ぎないというStability AI側の主張は退けられ、著作権法上の「複製」に該当すると判断

- ただし、損害額の算定については継続審理。Gettyの主張する損害額(数十億ドル規模)が認められるかは未定

- オープンソースモデルの利用者(Stable Diffusionを使う個人・企業)への責任の波及範囲は未確定

この訴訟の結果は、Stable Diffusionを使ったAI副業に直接影響します。もし最終的にStability AIの学習データ利用が違法と判断された場合、そのモデルで生成されたコンテンツの商用利用にも法的リスクが生じる可能性があるからです。

米国著作権局の重要判断

米国著作権局(U.S. Copyright Office)は、2025年に複数の重要な判断を下しました。

まず、2025年3月のThaler v. Perlmutter控訴審判決。Stephen Thalerが自身のAI「DABUS」が自律的に作成した画像の著作権登録を求めた訴訟で、連邦控訴裁判所は「AIは著作者(author)にはなれない」という地裁の判断を支持しました(米国裁判所)。この判決により、米国では「AIのみで作成した著作物には著作権が発生しない」という原則が確立しました。

次に、2025年5月に公表された米国著作権局のAI著作権に関する報告書では、AI生成物に関する以下の重要な結論が示されました。

米国著作権局の主要結論(2025年5月)

- AI生成物の学習目的の利用は、自動的にフェアユースとはみなされない

- AIが生成したコンテンツの著作権登録には、人間による「十分な創作的寄与」が必要

- プロンプトの入力だけでは「十分な創作的寄与」とは認められない

- AI生成物の利用にあたっては、既存の著作権法の枠組みが適用される

- AI開発者・提供者・利用者それぞれの責任範囲を明確化する必要がある

特に「プロンプト入力だけでは創作的寄与とは認められない」という判断は、AI副業者にとって重要です。単にプロンプトを入力して出力されたものをそのまま販売しても、著作権は主張できない可能性が高いということです。

日本国内の動向(読売新聞・朝日新聞の訴訟)

日本国内でも、AI著作権に関する重要な訴訟が進行しています。

| 訴訟名 | 提訴日 | 請求額 | 争点 | 現状 |

|---|---|---|---|---|

| 読売新聞 vs Perplexity AI | 2025年 | 約22億円 | 記事の無断要約・表示 | 審理中 |

| 朝日新聞 vs OpenAI | 2025年 | 非公開 | 記事の学習利用 | 審理中 |

| 日本新聞協会の声明 | 2024年 | ─ | AI学習への記事利用に反対 | 業界団体として声明 |

読売新聞の訴訟は、AI検索サービス「Perplexity AI」が読売新聞の記事を無断で要約・表示しているとして、約22億円の損害賠償を請求するものです。この訴訟は、AIによるコンテンツの「要約」が著作権侵害に当たるかという、AI副業にも直結する論点を含んでいます。

もしこの訴訟で「AIによる要約は翻案権侵害」と判断されれば、他人の記事をAIで要約して自分のブログに掲載するという副業手法は、法的にアウトということになります。まとめサイトやキュレーションメディアを運営している方は、この訴訟の動向を注視しておくべきでしょう。

朝日新聞の訴訟は、OpenAIがChatGPTの学習に朝日新聞の記事を無断で使用したことに対する訴訟です。New York Times vs OpenAI訴訟(米国)と同様の構図であり、AI企業の学習データ利用の合法性を問うものです。

これらの訴訟は、日本のAI著作権の判例を形成する上で極めて重要です。判決次第では、AI副業のルールが大きく変わる可能性があります。

文化庁が示す「正しいAI活用」のガイドライン

法律や判例だけでは判断が難しい部分も多いAI著作権の問題。そこで頼りになるのが、日本の著作権行政を所管する文化庁が公表しているガイドラインです。ここでは、2024年に公表された重要なガイドラインの内容と、AI副業者が守るべきルールを解説します。

「AIと著作権に関するチェックリスト」の要点

文化庁は2024年3月に「AIと著作権に関する考え方について」を取りまとめ、さらに2024年7月31日に「AIと著作権に関するチェックリスト&ガイダンス」を公表しました。このガイダンスは、AI開発者・AI提供者・AI利用者・著作権者の4者それぞれに向けた具体的な指針を示しています。

AI副業者(=AI利用者)に特に関係する主なポイントは以下の通りです。

文化庁チェックリスト:AI利用者向けの要点

- 生成物の類似性確認義務:AI生成物が既存の著作物に類似していないか、利用者自身が確認する責任がある

- 「享受目的」の判断基準:AI生成物を楽しむ・鑑賞する目的で利用する場合は、著作権法30条の4の例外(AI学習の許容規定)は適用されない

- プロンプトへの著作物利用:プロンプトに既存の著作物を含める場合(例:「この画像を参考に~」)は、著作権侵害のリスクがある

- 商用利用時の追加注意:商用利用の場合は特に慎重な対応が求められる

また、文化庁のガイダンスでは、AI学習段階における著作権法30条の4の「但し書き」(著作権者の利益を不当に害する場合は除外)の具体的な判断基準も示されています。

| 判断要素 | 「不当に害する」に該当しやすいケース | 該当しにくいケース |

|---|---|---|

| 学習データの性質 | 特定クリエイターの作品のみを集中的に学習 | 広範なデータセットの一部として学習 |

| 生成物の用途 | 元の著作物と競合する市場での販売 | 元の著作物とは異なる市場での利用 |

| 著作権者への影響 | 著作権者の収益を直接減少させる | 著作権者の市場に影響を与えない |

| データの入手方法 | 技術的保護手段を回避して取得 | 公開されている情報を取得 |

AI利用者が守るべき4つのルール

文化庁のガイドラインを踏まえ、AI副業者が守るべきルールを4つに整理しました。

ルール1:生成前の確認──プロンプトに著作物を含めない

プロンプトに特定の作品名、キャラクター名、クリエイター名を含めることは避けましょう。「この画像を参考にして」と既存の著作物をアップロードする行為も、著作権法上の「複製」に該当する可能性があります。一般的な表現(「水彩画風」「サイバーパンクな雰囲気」など)でプロンプトを構成することが安全です。

ルール2:生成後の確認──既存著作物との類似性チェック

AI生成物が完成したら、Google画像検索やTinEyeなどのリバースイメージ検索を使って、既存の著作物と類似していないか確認しましょう。テキストの場合は、コピーコンテンツチェッカーなどのツールで盗用チェックを行いましょう。

ルール3:利用時の注意──利用規約の遵守と記録

使用するAIツールの利用規約を必ず確認し、商用利用が許可されていることを確認しましょう。また、どのツールで・どのようなプロンプトで・いつ生成したかの記録を残しておくことが重要です。後日トラブルが発生した際に、自分の行為が正当であったことを証明する資料になります。

ルール4:公開・販売時の対応──AI生成であることの開示

法的義務ではない場合でも、AI生成物であることを明示することを推奨します。これは倫理的な配慮であると同時に、リスクヘッジでもあります。「AI生成であることを隠して販売した」と後日指摘された場合、消費者保護法上の問題(優良誤認表示等)に発展する可能性があるからです。

AI副業を安全に行うための7つの実践チェックリスト

ここまでの法律知識を踏まえ、AI副業を安全に行うための実践的なチェックリストを7つにまとめました。「面倒だ」と感じるかもしれませんが、1つのチェックを怠ったために数百万円の損害賠償を請求されるリスクを考えれば、安い保険です。このチェックリストを印刷して、AIで何かを作るたびに確認することをおすすめします。

チェック1〜3:事前確認編

事前確認チェックリスト

-

チェック1:使用するAIツールの利用規約を確認したか?

商用利用が許可されているプラン・条件を確認します。特にMidjourneyは無料プランでの商用利用が禁止されています。規約は頻繁に更新されるため、月に1回は最新の規約を確認する習慣をつけましょう。

具体的なアクション:各ツールの公式サイトでTerms of Service/利用規約ページをブックマークし、定期的に確認する。変更があった場合は自分のワークフローへの影響を評価する。

-

チェック2:プロンプトに特定の著作物・人物・ブランド名を含めていないか?

特定の作品名(「鬼滅の刃風」)、クリエイター名(「新海誠風」)、キャラクター名(「ピカチュウのような」)、ブランド名(「Louis Vuittonのパターン」)などをプロンプトに含めることは著作権・商標権侵害のリスクを高めます。一般的な表現に置き換えましょう。

NG例:「ジブリの千と千尋の湯屋のような日本の温泉旅館」

OK例:「木造の日本伝統的な温泉旅館、蒸気が立ち上る、ノスタルジックな夕暮れの雰囲気」

-

チェック3:参考素材をプロンプトにアップロードしていないか?

「この画像を参考にして似たものを生成して」というプロンプトで他者の著作物をアップロードすると、著作権法上の「複製」や「翻案」に該当する可能性があります。参考にしたい場合は、テキストで特徴を記述する方法を選びましょう。

チェック4〜5:制作編

制作段階チェックリスト

-

チェック4:生成物を既存著作物と照合したか?

AI生成物が既存の著作物に酷似していないかを確認します。画像の場合はGoogle画像検索やTinEyeで、テキストの場合はコピーコンテンツチェッカーで確認しましょう。特に、AIが有名な作品を「暗記」していて、ほぼそのまま出力するケースがあるため、チェックは必須です。

画像のチェック方法:

- Google画像検索で生成画像をアップロードして類似画像を検索

- TinEyeで逆画像検索を実行

- 類似度の高い画像が見つかった場合は使用を中止

テキストのチェック方法:

- CopyContentDetectorで類似テキストを検索

- 特に専門用語や固有の表現が含まれる箇所を重点的にチェック

- 一致率が高い部分は書き直しまたは削除

-

チェック5:人間の創作的寄与を加えたか?

AI生成物をそのまま使うのではなく、必ず人間の手で加工・編集を加えましょう。これにより、(1)既存著作物との類似性が低下し、(2)著作権が認められやすくなり、(3)コンテンツの品質も向上します。

画像の場合:色調調整、構図変更、要素の追加・削除、複数の生成物の合成、手動でのレタッチ

テキストの場合:独自の体験・見解の追加、構成の再編成、データ・出典の確認と追加、表現の書き換え

チェック6〜7:公開・販売編

公開・販売チェックリスト

-

チェック6:AI生成であることを適切に開示しているか?

法的義務がない場合でも、AI生成物であることを明示することを強く推奨します。特にストック素材として販売する場合、多くのプラットフォーム(Adobe Stock、Shutterstock等)がAI生成コンテンツの開示を義務化しています。開示しないと、プラットフォームの規約違反でアカウント停止になるリスクもあります。

開示の方法例:

- 画像のメタデータにAI生成であることを記録

- 販売ページの説明文に「AI生成画像」「AIアシスト制作」等を明記

- ブログ記事の場合は「AI技術を活用して制作しています」等の注記

-

チェック7:販売プラットフォームの規約を確認したか?

AI生成コンテンツに対する各プラットフォームのルールは異なります。最新の規約を必ず確認しましょう。

プラットフォーム AI生成コンテンツの扱い 開示義務 Adobe Stock 受付可(審査あり) あり(必須) Shutterstock 受付可(条件付き) あり(必須) PIXTA 条件付き受付 あり(必須) LINE Creators Market AI利用可(審査あり) 推奨 Amazon KDP AI利用可(条件付き) あり(必須) note AI利用可 推奨 ココナラ AI利用可(カテゴリ注意) サービスにより異なる

この7つのチェックリストを毎回確認することで、著作権トラブルのリスクを大幅に低減できます。最初は面倒に感じるかもしれませんが、慣れてくれば数分で完了します。「安全にAI副業を続けるための投資」と考えて、習慣化してください。

世界のAI規制トレンド|EU AI法が日本に与える影響

AI副業を長期的に安全に続けるためには、世界の規制トレンドも把握しておく必要があります。特に、2024年5月に成立したEU AI法(AI Act)は、日本を含む世界中のAI利用者に影響を与える可能性があります。

EU AI法の段階的施行スケジュール

EU AI法は、世界で初めて包括的にAIを規制する法律です。2024年5月21日に欧州理事会で正式に採択され、段階的に施行が進んでいます(European Commission)。

| 施行時期 | 対象 | 主な内容 |

|---|---|---|

| 2025年2月 | 禁止AI | 許容できないリスクのAI(ソーシャルスコアリング等)の禁止 |

| 2025年8月 | 汎用AI(GPAI) | 大規模言語モデル等の透明性義務。学習データの著作権法遵守義務 |

| 2026年8月 | 高リスクAI | 医療・教育・採用等に使用されるAIシステムへの規制 |

| 2027年8月 | 完全施行 | すべての規定が有効に |

AI副業者にとって特に重要なのは、2025年8月の「汎用AI(GPAI)」に関する規制です。この規制により、ChatGPTやMidjourney、Stable Diffusionなどの大規模AIモデルの提供者は、以下の義務を負うことになります。

- 学習データに関する透明性の確保:どのようなデータで学習したかを開示する義務

- 著作権法の遵守:EU加盟国の著作権法に基づき、学習データの利用が合法であることを証明する義務

- AI生成コンテンツの識別:AI生成物であることを示すウォーターマーク等の技術的手段の実装

違反した場合の罰則は、年間売上高の7%または3,500万ユーロ(約56億円)のいずれか高い方と、非常に厳しい内容です。

ここで重要なのが、EU AI法は「域外適用」を含むという点です。EU域内にサービスを提供する場合、企業の所在地がEU外であっても規制の対象となります。つまり、日本のAI副業者がEU在住のユーザーに対してAI生成コンテンツを販売する場合も、EU AI法が適用される可能性があるのです。

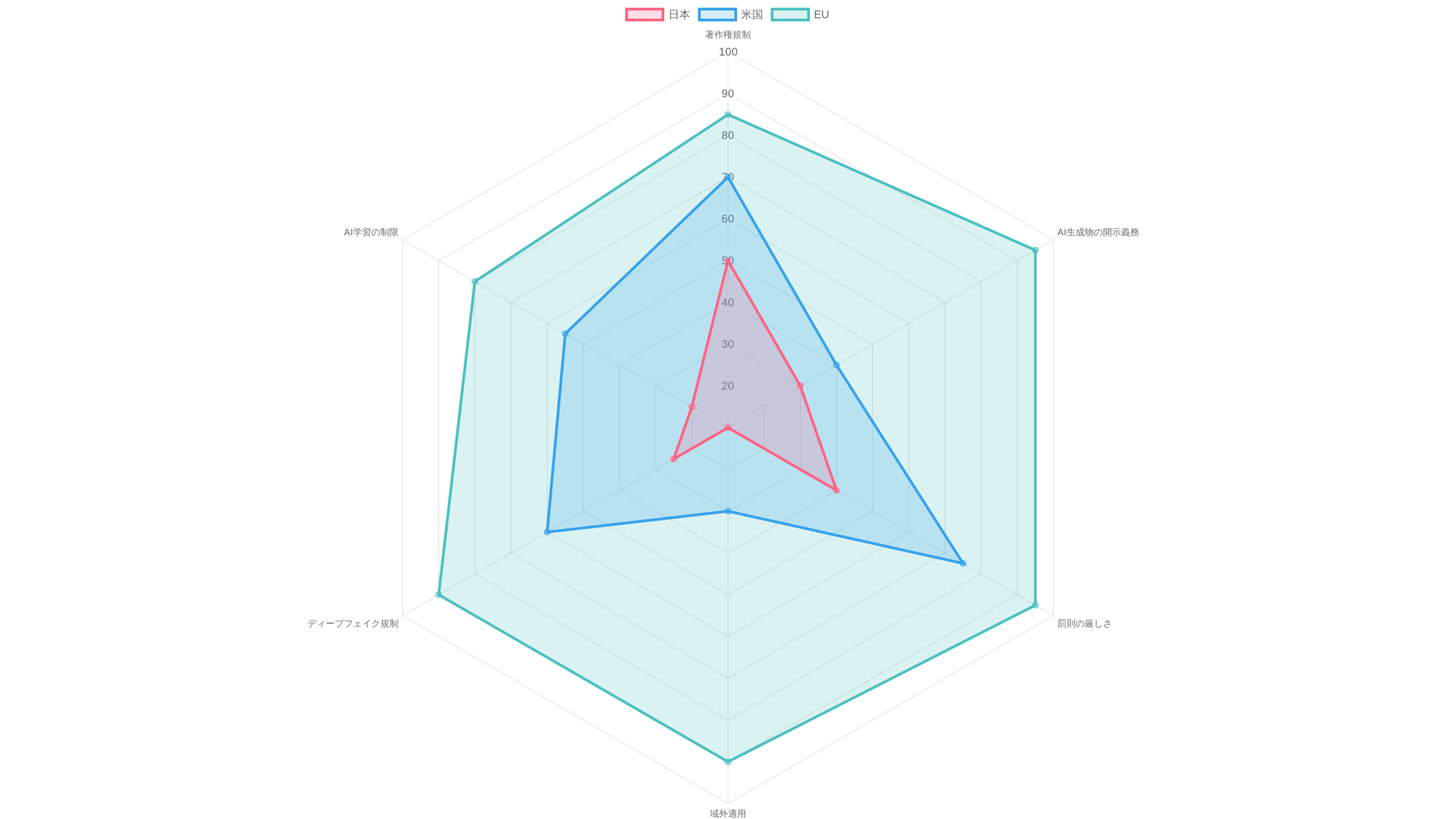

日本・米国・EUの規制比較

世界の主要3地域(日本・米国・EU)のAI規制アプローチを比較してみましょう。

| 項目 | 日本 | 米国 | EU |

|---|---|---|---|

| 規制アプローチ | ソフトロー中心(ガイドライン) | セクター別規制 | 包括的規制(AI Act) |

| AI学習の合法性 | 原則OK(30条の4) | フェアユースで争い中 | 透明性義務あり |

| AI生成物の著作権 | 人間の関与で判断 | 人間の著作者性が必要 | 明確な基準策定中 |

| 罰則の厳しさ | 中(著作権法の範囲) | 中〜高(訴訟大国) | 極めて高(売上の7%) |

| 開示義務 | 推奨(義務化議論中) | 連邦レベルでは未定 | 義務化(段階的に) |

| ディープフェイク規制 | 議論中 | TAKE IT DOWN Act成立 | 禁止(AI Act) |

この比較から見えるのは、日本のAI規制は現時点では比較的「緩やか」であるということです。しかし、EUや米国の規制強化を受けて、日本でも規制が強化される方向に動いています。2026年の通常国会では、AI関連の新法案が複数提出される見通しであり、「今は大丈夫」でも「来年はアウト」になる可能性があります。

AI副業を長期的に続けるなら、最も厳しい規制(EU AI法)を基準にして活動するのが最も安全です。そうすれば、どの国の規制が強化されても対応に追われることがありません。

まとめ|AI副業で「知らなかった」は最大のリスク

本記事では、AI副業における著作権リスクについて、基礎知識から最新判例、実践的なチェックリストまで幅広く解説してきました。最後に、重要なポイントを振り返りましょう。

この記事の要点まとめ

- AI副業の法的リスクは現実のもの:2025年だけでAI著作権訴訟の和解額は世界で4,000億円超。個人も訴訟の対象になり得る

- 著作権の3フェーズを理解する:学習段階(30条の4で原則OK)→生成段階(類似性チェックが重要)→利用段階(商用利用ルールの遵守)

- 5つの危険パターンを避ける:「〇〇風」プロンプト、無加工利用、有名人の肖像生成、他者記事の要約、LoRA模倣

- AIツールの規約は必ず確認:安全性重視ならAdobe Firefly、コスパ重視ならChatGPT/DALL-E

- 著作権以外のリスクも忘れずに:肖像権、パブリシティ権、商標権、不正競争防止法

- 7つのチェックリストを習慣化:事前確認→制作→公開・販売の各段階でチェック

- 世界の規制トレンドをウォッチ:EU AI法の域外適用に備え、最も厳しい基準で活動する

AI副業は、正しい知識と適切なリスク管理があれば、非常に有望な収入源です。著作権法を理解し、各AIツールのルールを遵守し、チェックリストに従って活動すれば、法的トラブルのリスクを大幅に低減できます。

しかし、法律は日々変化しています。今日のグレーゾーンが、明日にはブラックゾーンになるかもしれません。だからこそ、「知らなかった」が最大のリスクなのです。この記事をブックマークしておき、定期的に見返すことをおすすめします。また、AI著作権に関する最新ニュースをフォローし、常にアンテナを張っておきましょう。

AIと上手に付き合いながら、安全で持続可能な副業を築いていきましょう。法律を味方にすれば、AI副業はあなたの強力な武器になります。

今日からできる3つのアクション

- 使用中のAIツールの利用規約を再確認する──特に商用利用の条件と禁止事項を確認

- 過去に作成したAI生成コンテンツの著作権チェック──Google画像検索やコピペチェッカーで類似性を確認

- 7つのチェックリストを印刷してデスクに貼る──AIで何か作るたびにチェックする習慣をつける

参考文献・出典

- 文化庁「AIと著作権に関する考え方について」(2024年3月)https://www.bunka.go.jp/seisaku/chosakuken/pdf/94037901_01.pdf

- 文化庁「AIと著作権に関するチェックリスト&ガイダンス」(2024年7月31日)https://www.bunka.go.jp/seisaku/chosakuken/

- 著作権法(昭和45年法律第48号)https://elaws.e-gov.go.jp/document?lawid=345AC0000000048

- 総務省「令和6年版 情報通信白書」https://www.soumu.go.jp/johotsusintokei/whitepaper/

- Grand View Research「Generative AI Market Report」https://www.grandviewresearch.com/industry-analysis/generative-ai-market-report

- Reuters「Bartz v. Anthropic – $1.5 billion settlement」https://www.reuters.com/legal/litigation/

- Thaler v. Perlmutter, No. 22-1564 (D.C. Cir. 2025)https://www.uscourts.gov/

- U.S. Copyright Office「Copyright and Artificial Intelligence」(2025年5月)https://www.copyright.gov/ai/

- Getty Images v. Stability AI, Case No. 1:23-cv-00135 (D. Del.)https://www.law.cornell.edu/

- 読売新聞「Perplexity AIに対する損害賠償請求」https://www.yomiuri.co.jp/

- OpenAI Terms of Usehttps://openai.com/policies/terms-of-use

- Midjourney Terms of Servicehttps://docs.midjourney.com/docs/terms-of-service

- Stability AI Community Licensehttps://stability.ai/license

- Adobe Firefly 利用規約https://www.adobe.com/jp/products/firefly.html

- Canva 利用規約https://www.canva.com/ja_jp/policies/terms-of-use/

- European Commission「Regulatory framework proposal on artificial intelligence」https://digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai

- EU AI Act(Regulation (EU) 2024/1689)https://eur-lex.europa.eu/legal-content/EN/TXT/?uri=CELEX:32024R1689

- TAKE IT DOWN Act(U.S. Congress, 2025)https://www.congress.gov/

- 最高裁判所「ピンク・レディー事件判決」(2012年2月2日)https://www.courts.go.jp/app/hanrei_jp/detail2?id=82044

- 商標法(昭和34年法律第127号)https://elaws.e-gov.go.jp/document?lawid=334AC0000000127

- 不正競争防止法(平成5年法律第47号)https://elaws.e-gov.go.jp/document?lawid=405AC0000000047

- Carlini, N. et al.「Extracting Training Data from Diffusion Models」(2023) https://arxiv.org/abs/2301.13188

- Google画像検索https://images.google.com/

- TinEye リバースイメージ検索https://tineye.com/

- CopyContentDetectorhttps://www.copycontentdetector.com/

- 日本新聞協会「AI学習に関する声明」(2024年)https://www.pressnet.or.jp/

- 知的財産戦略本部「AI時代の知的財産権検討会」https://www.kantei.go.jp/jp/singi/titeki2/

- 特許庁「AI関連技術に関する特許審査事例」https://www.jpo.go.jp/system/patent/gaiyo/sesaku/ai/index.html

- 内閣府「AI戦略2025」https://www8.cao.go.jp/cstp/ai/index.html

- WIPO「AI and Intellectual Property」https://www.wipo.int/about-ip/en/artificial_intelligence/

- New York Times v. OpenAI, Case No. 1:23-cv-11195 (S.D.N.Y.)https://www.nytimes.com/

- LINEヤフー for Businesshttps://www.lycbiz.com/jp/service/line-ads/

- Adobe Stock AIコンテンツ投稿ガイドラインhttps://helpx.adobe.com/stock/contributor/help/generative-ai-content.html

- Amazon KDP AIコンテンツガイドラインhttps://kdp.amazon.com/ja_JP/help/topic/GQKF4LHBXHV7BFVW

- 個人情報保護委員会「生成AIサービスの利用に関する注意喚起」https://www.ppc.go.jp/

コメント